abstract

今天上完liao(致敬)李保滨老师的矩阵分析课程,对线性变换有了更进一步的理解,李老师与Gilbert的课程还是有差异的,个人感觉Gilbert老师的18.06对线代的基础(4个基本子空间)讲的更透彻,而李老师再线性变换处更明了

prerequisite

矩阵乘法AB=C的意义、C的行列与A、B行列的关系、线性变换、向量空间。这要搞清楚,这里不展开。

基本概念

首先我们想一个问题,如何表示一个物体,其实小时候大家都做过这样的数学题,在坐标轴**(笛卡尔棒棒)上对一些坐标标点,最后把这些点连起来,最终就会得到一个可爱的猫猫啦。可见,坐标可以用来描述物体。但是,仅仅是坐标就足够了吗。look, here’s the deal(poor Biden…),当然不是的,题目给出坐标时,默认了我们都在空间的标准基(standard basis)里。所以,除了坐标之外,我们还需要空间的基。

比如说,我们说一点(object)的coordinate是c = (1,2,3),实际上我们默认是在说这个object = c1*e1 + c2*e2 + c3*e3。只是我们选择的基太tricky了,所以可以用coordinate stand for that object directly(important)。

这样,用基和坐标,就可以表述出我们的猫猫(客观物体object)了。

tips:Gilbert的书中貌似有点说不清楚object与coordinate的关系(当然是我太菜了)**,李老师证明了:在给定基下,每一个线性变换都有其矩阵表示。

Prove: 在给定基下,每一个线性变换都有其矩阵表示

证明思路:联想到普通情况,令{e1, e2, e3}为$R^3$的基,我们如何证明在$R^3$空间中的任一目标,都能表示出来呢?obviously,令一个系数向量C(3x1)代表坐标,一个矩阵代表基B(3x3),那么,BC就可以唯一表示这个object了。同理,李老师的证明过程如下:

- $U$与$V$分别代表两个向量空间$U=R^n$, $V=R^m$,把从

U->V的所有线性变换放到一个集合里,记作L(U, V),那么L(U, V)是一个向量空间。

- 令$U$、$V$的基分别是

B={u1, u2,…,un}、B'={v1, v2,…,vm}。定义$T_{ji}(u)=\xi_jv_i$,$(\xi_1, \xi_2…\xi_n)^T=[u]_B$(tips: 即object u在基B下的坐标表示)`,那么,我们可以得出下面结论3:

- $ T_L = \left { T_{ji}\right }_{j=1…n}^{i=1…m} $是

L(U, V)的一组基。

- 如果有了结论3,那么得证。 即给定空间U、V的基,任意一个从

U -> V的线性变换,我们都可以用这组基$T_L$来表示,而表示的坐标coordinate,即是:在U、V的给定基下,从U -> V线性变换T的矩阵表示。

证明$ T_L = \left { T_{ji}\right }_{j=1…n}^{i=1…m} $是L(U, V)的一组基

证明思路:1.$T_L$是线性无关的。2.$L(U, V)$中的任意一个元素,都能用$T_L$中的元素表示。

1.根据定义即证明$\sum_{j,i}\eta_{ji}T_{ji} = 0$中的所有$\eta_{ji}只能等于0$。这个鬼东西怎么证明呢,用到了一个小trick**(tips:我这非数学专业就不去想那些老头子怎么想出来的了)**

\begin{equation}\label{1}

T_{ji}(u_k) = \left{\begin{matrix}

v_i & j=k\

0 & j≠k

\end{matrix}\right.

\end{equation}

现在把要证的等式两端同时乘以$u_k$,即基组$U$的第k个基,得到

\begin{equation}\label{2}

(\sum_{j,i}\eta_{ji}T_{ji})(u_k) = 0

\end{equation}

去括号,相当于把$u_k$做${T_{ji}}$变换。

\begin{equation}\label{3}

\sum_{j,i}\eta_{ji}T_{ji}(u_k) = 0

\end{equation}

结合公式1,即可得出

\begin{equation}\label{4}

\sum_{i=1}^{m}\eta_{ki}v_i = 0

\end{equation}

因为${v_1,v_2,v_3..v_m}$是输出空间空间$V$的一组基底,所以所有 $\eta$ 都等于0,得证。

要证第二个,首先要搞清楚$L(U, V)$中的元素是什么,exactly。这个集合里面存放的是:从$U$ -> $V$的所有线性变换。

现从$L(U,V)$中任取一个元素$T’$,now, enjoying this formulation,hahaha

\begin{equation}\label{5}

T(u) = T(\sum_{j=1}^{n}\xi_ju_j) = \sum_{j=1}^{n}\xi_jT(u_j) = \sum_{j=1}^{n}\xi_j \sum_{i=1}^{m}\alpha_{ij}v_i = \sum_{i, j}\alpha_{ij}\xi_jv_i = \sum_{i, j}T_{ji}(u)

\end{equation}

非常漂亮的过程。

现在,我们想证明的都证明完了,就可以说, 在给定输入空间$U$、输出空间$V$,以及他们自个的基$B$、$B’$下,每一个从$U$到$V$的线性变换都有其矩阵表示。

Brain Expansion

上述表述有一个flaw我没有提,你看那个第3点,为什么我们要把$T_{ji}(u)=\xi_jv_i$, $(\xi_1, \xi_2…\xi_n)^T=[u]B$, $ T_L = \left { T{ji}\right }{j=1…n}^{i=1…m} $作为L(U, V)的一组基呢,它代表着啥含义。这点老师上课也没有讲(or 我走神了?)下面我简单分析一下

首先我们看一下这个表达式

\begin{equation}\label{6}

T{ji}(u_k) = \left{\begin{matrix}

v_i & j=k\

0 & j≠k

\end{matrix}\right.

\end{equation}

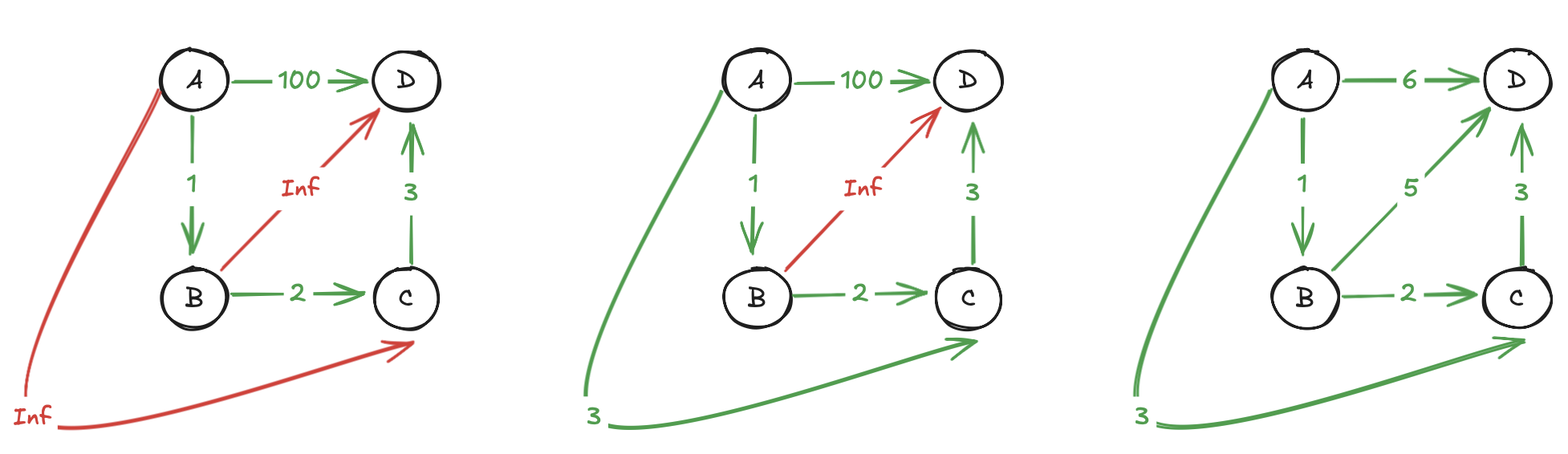

将上面三个带入就发现这是成立的,即经过$T_{ki}$变换,$u_k$变换成了$v_i$,并且这个$T_{ki}$将其他的基$u_z(z≠k)$变成了0。穷举法,任意一个变换可能将原来空间的基$u_{1,2…n}$,变换成任意一个输出空间基的倍数$v_{1,2…m}$。所以,将这mxn朴素变换(我瞎说的词)进行线性组合,既可以组合成任意在给定输入空间$U$、输出空间$V$,以及他们自个的基$B$、$B’$下,从$U$到$V$的线性变换。想出这个证明的人,我愿称之为现代王!

再往下延拓就是如何将这个变换用矩阵表示出来了,具体做法也很简单,这里就不说了

Summary

我在读Gilbert的setction 8的时候,总是分不清其表达式$T(u)=u$的这两个u到底是代表的object还是coordinate。但是李老师讲解的过程$T(u)$很明确,就是说对object u 进行 $T$变换。不过遗憾的是,李老师这堂课的视频并没有放出来,我上面的东西估计只有我自己能看懂hhh,(tips: 大家不妨试试@一下UCAS的教务处^-^)。(再tips:上课已一月有余,北京的冷空气让我的厚衣服屁用都没有了)。